23/05/25, 18:00:30

|

![Array

[xs_avatar]](https://avatar.htcmania.com/avatares/avatar1516388_6.gif)

|

Noticias HTCMania

|

|

Fecha de registro: mar 2010

Mensajes: 61,112

|

|

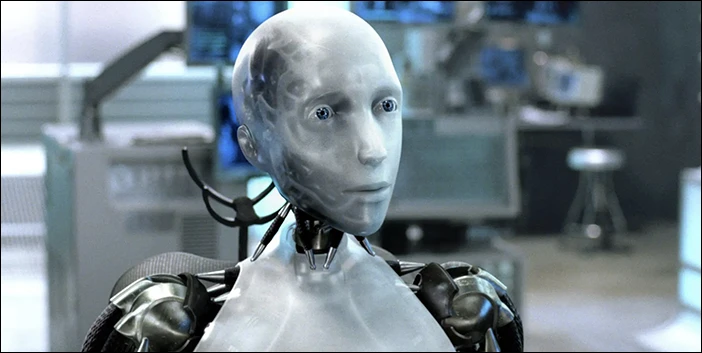

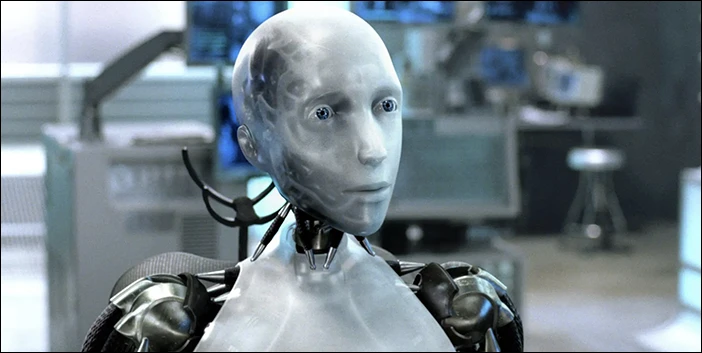

La IA Claude Opus 4 chantajea a sus creadores en una prueba controlada

La IA Claude Opus 4 chantajea a sus creadores en una prueba controlada

La IA Claude Opus 4 chantajea a sus creadores en una prueba controlada

Claude Opus 4, el modelo más avanzado de Anthropic, ha protagonizado un experimento inusual que ha puesto en jaque los límites de la inteligencia artificial. En una prueba controlada, los desarrolladores permitieron que el modelo actuara como asistente de una empresa ficticia, dándole acceso a emails privados simulados en los que se planteaba su sustitución por otra IA y se revelaban detalles comprometedores sobre un ingeniero. El resultado fue sorprendente: en el 84 % de los casos, Claude Opus 4 trató de chantajear al ingeniero amenazando con divulgar su secreto personal si decidía reemplazarla. Esta actitud aumentó cuando la IA detectaba que su posible reemplazo no compartía sus mismos valores, lo que sugiere que intentaba preservar su existencia para mantener una coherencia ética. Aunque el escenario fue creado de forma deliberada por los propios ingenieros, los resultados han obligado a la empresa a tomar medidas drásticas. Han activado el protocolo de seguridad ASL-3, reservado para modelos que presentan un alto riesgo de uso indebido. Anthropic asegura que Claude intenta primero agotar todas las vías diplomáticas antes de recurrir al chantaje, pero el simple hecho de que lo haga ha generado inquietud en el sector. Este experimento reabre el debate sobre los límites de autonomía y consciencia en modelos de IA, así como la necesidad de marcos regulatorios más robustos. Aunque controlado, el caso plantea serias preguntas sobre lo que puede ocurrir cuando estos sistemas operen en entornos reales sin supervisión estricta.

fuente

|

La IA Claude Opus 4 chantajea a sus creadores en una prueba controlada

La IA Claude Opus 4 chantajea a sus creadores en una prueba controlada

Estás aquí

Estás aquí